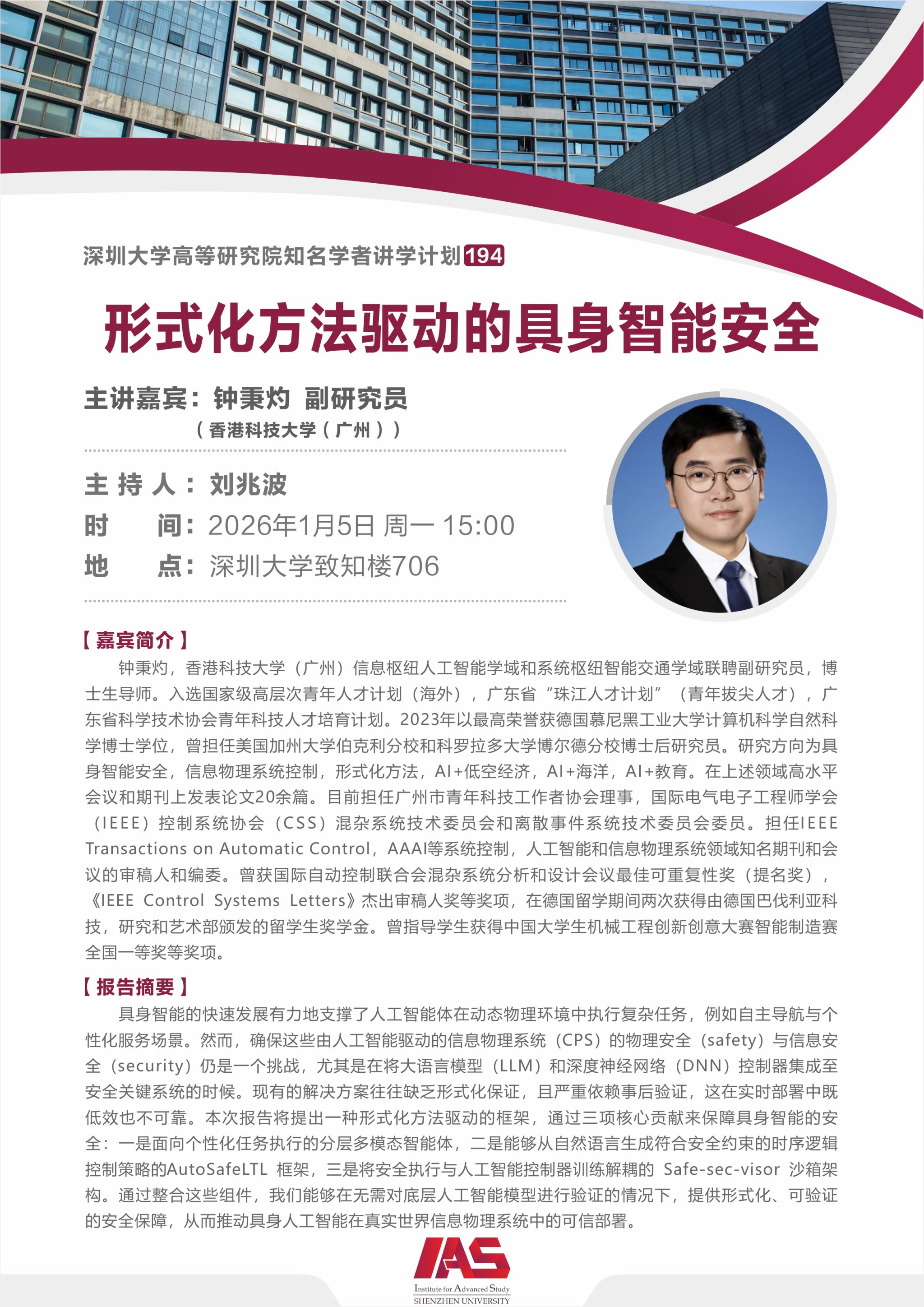

报告主题:形式化方法驱动的具身智能安全

主 讲 人:钟秉灼 副研究员(香港科技大学(广州))

主 持 人:刘兆波

时 间:2026年1月5日(一)15:00

地 点:致知楼706

嘉宾简介:

钟秉灼,香港科技大学(广州)信息枢纽人工智能学域和系统枢纽智能交通学域联聘副研究员,博士生导师。入选国家级高层次青年人才计划(海外),广东省“珠江人才计划”(青年拔尖人才),广东省科学技术协会青年科技人才培育计划。2023年以最高荣誉获德国慕尼黑工业大学计算机科学自然科学博士学位,曾担任美国加州大学伯克利分校和科罗拉多大学博尔德分校博士后研究员。研究方向为具身智能安全,信息物理系统控制,形式化方法,AI+低空经济,AI+海洋,AI+教育。在上述领域高水平会议和期刊上发表论文20余篇。目前担任广州市青年科技工作者协会理事,国际电气电子工程师学会(IEEE)控制系统协会(CSS)混杂系统技术委员会和离散事件系统技术委员会委员。担任IEEE Transactions on Automatic Control,AAAI等系统控制,人工智能和信息物理系统领域知名期刊和会议的审稿人和编委。曾获国际自动控制联合会混杂系统分析和设计会议最佳可重复性奖(提名奖),《IEEE Control Systems Letters》杰出审稿人奖等奖项,在德国留学期间两次获得由德国巴伐利亚科技,研究和艺术部颁发的留学生奖学金。曾指导学生获得中国大学生机械工程创新创意大赛智能制造赛全国一等奖等奖项。

报告摘要:

具身智能的快速发展有力地支撑了人工智能体在动态物理环境中执行复杂任务,例如自主导航与个性化服务场景。然而,确保这些由人工智能驱动的信息物理系统(CPS)的物理安全(safety)与信息安全(security)仍是一个挑战,尤其是在将大语言模型(LLM)和深度神经网络(DNN)控制器集成至安全关键系统的时候。现有的解决方案往往缺乏形式化保证,且严重依赖事后验证,这在实时部署中既低效也不可靠。本次报告将提出一种形式化方法驱动的框架,通过三项核心贡献来保障具身智能的安全:一是面向个性化任务执行的分层多模态智能体,二是能够从自然语言生成符合安全约束的时序逻辑控制策略的AutoSafeLTL 框架,三是将安全执行与人工智能控制器训练解耦的 Safe-sec-visor 沙箱架构。通过整合这些组件,我们能够在无需对底层人工智能模型进行验证的情况下,提供形式化、可验证的安全保障,从而推动具身人工智能在真实世界信息物理系统中的可信部署。